(TAP) - Tổng thống Donald Trump vừa ra lệnh toàn bộ cơ quan liên bang Hoa Kỳ lập tức chấm dứt sử dụng hệ thống trí tuệ nhân tạo (AI) do Anthropic phát triển. Quyết định được đưa ra sau nhiều tuần căng thẳng giữa Bộ Chiến tranh và doanh nghiệp này về việc gỡ bỏ một số hạn chế tích hợp trong mô hình Claude.

Tổng thống Trump yêu cầu toàn bộ cơ quan liên bang chấm dứt hợp tác với Anthropic. Nguồn: Council on Foreign Relations

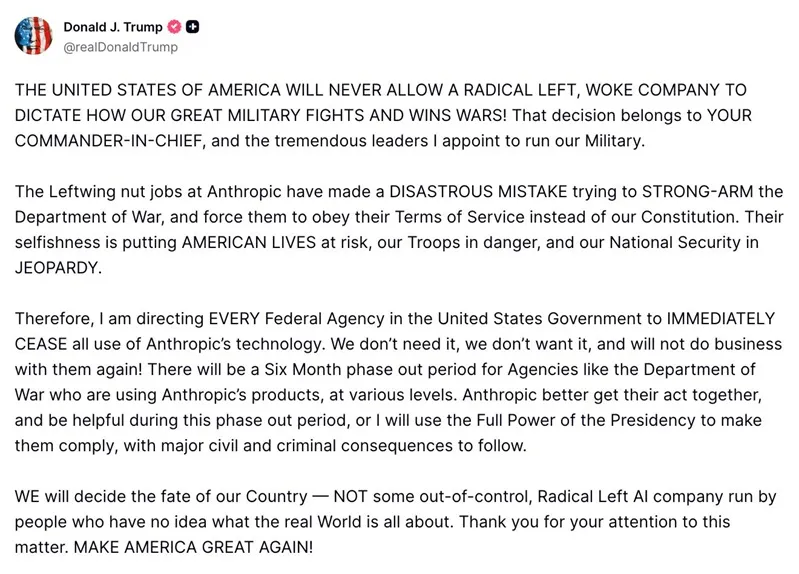

Trong bài đăng ngày 27/2 trên nền tảng Truth Social (@realDonaldTrump), Tổng thống Donald Trump tuyên bố: “Tôi đang chỉ thị cho tất cả cơ quan liên bang thuộc Chính phủ Hoa Kỳ ngừng sử dụng công nghệ của Anthropic. Chúng tôi không cần, không muốn, không bao giờ hợp tác với họ nữa”. Các cơ quan liên bang khác phải dừng sử dụng ngay lập tức ngoại trừ Bộ Chiến tranh Hoa Kỳ có thời hạn 6 tháng để loại bỏ hoàn toàn sản phẩm do Anthropic phát triển. Ông Trump cảnh báo, nếu Anthropic không hỗ trợ quá trình chuyển đổi, ông sẽ dùng quyền lực Tổng thống buộc doanh nghiệp tuân thủ, kèm những hậu quả về pháp lý dân sự và hình sự nghiêm trọng.

Ngoài ra, ông Trump chỉ trích Anthropic là một công ty “cực đoan, cánh tả, theo chủ nghĩa ‘woke’”. Đồng thời ông đánh giá, sự cứng rắn về điều khoản dịch vụ của Anthropic đã “sai lầm nghiêm trọng”, trực tiếp đẩy an ninh quốc gia, mạng sống các binh sĩ vào thế nguy hiểm. Lãnh đạo Hoa Kỳ nhấn mạnh: “Chúng ta sẽ quyết định vận mệnh đất nước - chứ không phải một công ty AI cánh tả cực đoan mất kiểm soát, được điều hành bởi những người không hiểu thế giới thực”.

Ông Trump đăng tải một thông điệp dài chỉ trích Anthropic. Nguồn: Truth Social (@realDonaldTrump)

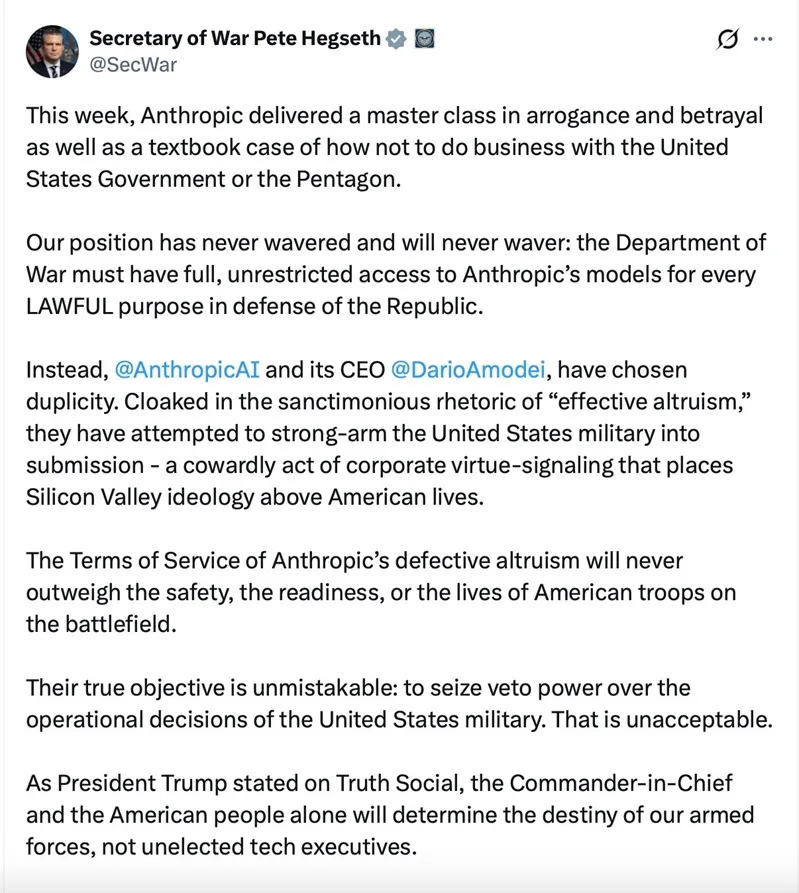

Sự leo thang căng thẳng đạt đến đỉnh điểm khi Bộ trưởng Chiến tranh Pete Hegseth ngày 27/2 thông báo xếp Anthropic vào danh sách “chuỗi cung ứng rủi ro đối với an ninh quốc gia”. Ông Hegseth viết trên trang X (@SecWar) rằng: “Tôi chỉ thị Bộ Chiến tranh xếp Anthropic vào danh sách chuỗi cung ứng rủi ro với an ninh quốc gia. Có hiệu lực ngay lập tức”. Như vậy, các nhà thầu cho quân đội Hoa Kỳ sẽ không thể phép dùng mô hình AI Claude trong bất kỳ dự án hay hợp đồng nào ký kết cùng Lầu Năm Góc.

Bộ trưởng Chiến tranh Pete Hegseth thông báo xếp Anthropic vô danh sách “chuỗi cung ứng rủi ro đối với an ninh quốc gia”. Nguồn: X (@SecWar)

Phía Anthropic cùng ngày đã đưa ra thông cáo chính thức liên quan đến động thái từ Bộ trưởng Chiến tranh Hoa Kỳ. Nội dung thông cáo ghi rõ: “Chúng tôi rất đau buồn trước quyết định trên”. Anthropic nhận định, việc bị chỉ định vào danh sách “chuỗi cung ứng rủi ro đối với an ninh quốc gia” là một hành động “chưa từng có tiền lệ” bởi biện pháp này chỉ áp dụng lên những quốc gia đối địch. Đồng thời, Anthropic nhấn mạnh sẽ “thách thức” chỉ thị từ Lầu Năm Góc tại toà án.

Anthropic cũng ra thông cáo trước quyết định của Bộ Chiến tranh. Nguồn: Anthropic

Trước đó, vào tháng 7/2025 Anthropic - đơn vị phát triển mô hình trí tuệ nhân tạo Claude đạt hợp đồng trị giá 200 triệu USD với Bộ Chiến tranh để phát triển sản phẩm AI cho quân đội. Phía công ty nhấn mạnh họ là phòng thí nghiệm AI đầu tiên trên thế giới được phép triển khai mô hình ở mạng lưới bảo mật thuộc Chính phủ Hoa Kỳ. Theo tờ Axios, lực lượng tình báo và quân đội Hoa Kỳ từng sử dụng mô hình Claude tại chiến dịch đột kích bắt giữ Tổng thống Venezuela Nicolas Maduro hồi tháng 1 năm nay.

Tuy nhiên, mối quan hệ đối tác đã rạn nứt sau nhiều tháng đàm phán căng thẳng giữa 2 bên xoay quanh việc kiểm soát mục đích sử dụng AI trong an ninh quốc gia. Phía Anthropic yêu cầu Bộ Chiến tranh phải cam kết mang tính ràng buộc pháp lý không sử dụng trí tuệ nhân tạo để giám sát hàng loạt nhắm vào công dân Hoa Kỳ và ở hệ thống vũ khí hoàn toàn. Còn Lầu Năm Góc yêu cầu Anthropic mở quyền truy cập sử dụng AI không hạn chế cho quân đội Hoa Kỳ. Đáng chú ý, ông Hegseth áp thời hạn đến 17 giờ ngày 27/2, Anthropic phải chấp nhận nhượng bộ nếu không sẽ đối mặt những hậu quả tiềm tàng.

Song, ông Dario Amodei - CEO Anthropic ngày 26/1 bác bỏ đề nghị từ Lầu Năm Góc. Ông tuyên bố trên website công ty rằng: “Sức ép này không làm thay đổi lập trường: về mặt lương tâm, chúng tôi không thể chấp nhận yêu cầu đó”.

Mie Duong